- OplossingenPeople Centric Workplace

OPLOSSINGEN

People Centric Workplace

Werk vanaf iedere locatie op basis van Microsoft 365.

Microsoft Azure

Breng uw bedrijfsapplicaties naar de Cloud.

Hardware

Bestel zakelijke apparaten in de webshop.

SecurityOPLOSSINGEN

Data Protection

Bescherm uw gegevens om verlies te voorkomen.

Device Protection

Bescherm uw apparaten tegen malware en andere dreigingen.

Email Protection

Bescherm tegen aanvallen, zoals phishing, malware en spam.

Identity Protection

Voorkom identiteitsdiefstal en ongeoorloofde toegang.

ADD-ONS

Cyber Security Scan

Krijg inzicht in uw beveiligingsrisico’s en aanvalsoppervlak.

Security Awareness

Creëer cyber-awareness onder uw medewerkers.

Back-up & Recovery

Herstel data binnen uw Microsoft 365 Cloud omgeving.

CollaborationOPLOSSINGEN

Cloud Based File Sharing

Laat Teams, SharePoint en OneDrive voor u werken.

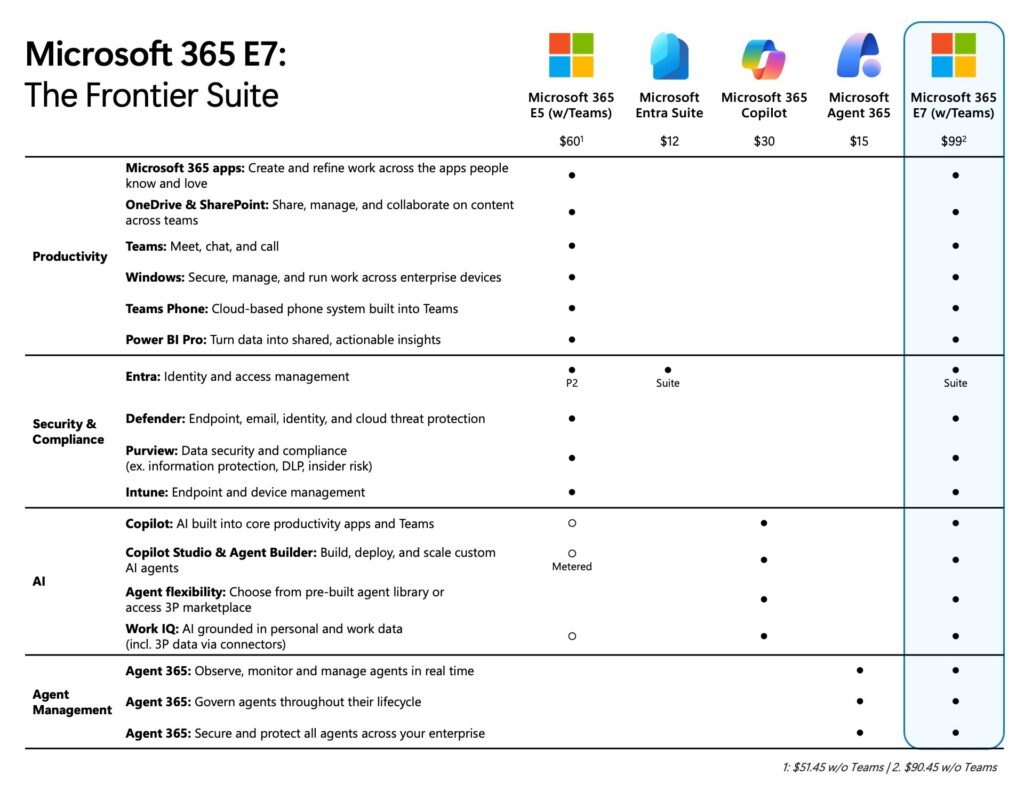

Copilot for Microsoft 365

Vergroot creativiteit en productiviteit in uw organisatie met AI.

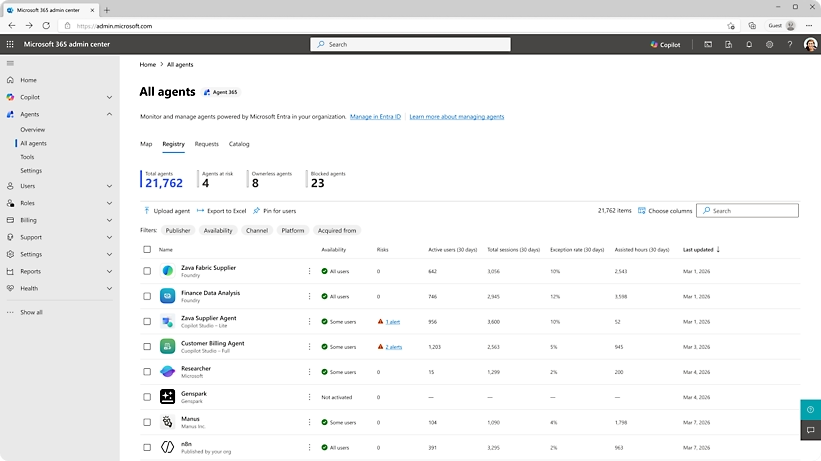

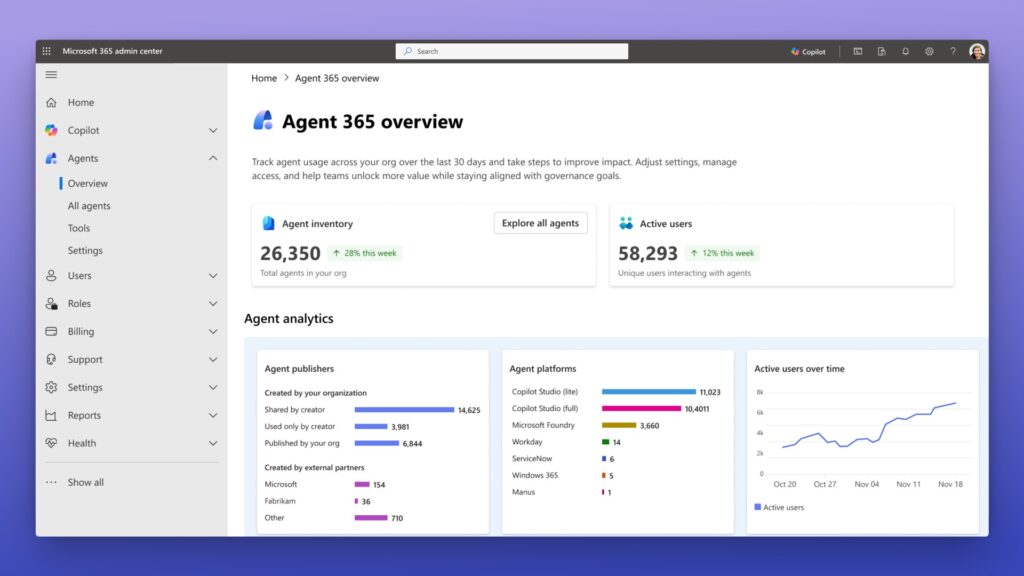

Copilot Agents

Breng processen, data en meer samen met intelligente digitale assistenten.

SharePoint Intranet

Zet SharePoint in als krachtig communicatieplatform.

ADD-ONS

Email Signature Management

Beheer e-mailhandtekeningen in uw organisatie centraal.

Viva Engage

Verbind iedereen in de organisatie met elkaar in Viva Engage.

Permission Matrix Report

Houdt grip op wildgroei aan unieke rechten in SharePoint.

AdoptionOPLOSSINGEN

Adoption Program

Digitale transformatie met de eindgebruiker als middelpunt.

Floorwalking

Persoonlijke begeleiding op de werkvloer.

Training

Een zachte landing in uw Microsoft 365 omgeving.

ADD-ONS

Ask me Anything

OfficeGrip Adoptie Consultants beschikbaar via Teams.

Online Academy

Centrale hub voor beleid- en kennisdeling.

Online Onboarding

Geef nieuwe medewerkers een zachte landing.

CommunicationsOPLOSSINGEN

Microsoft Teams telefonie

Optimale bereikbaarheid met vaste telefonie via Microsoft Teams.

Mobiele telefonie

Mobiele telefonie van Odido met Hello Business.

Vast-mobiel integratie

Integreer uw vaste en mobiele nummer binnen Teams.

ADD-ONS

Data sim

Veilig internetten onderweg op uw tablet of laptop.

Hardware

Communicatie & conferentie producten

NetworkingOPLOSSINGEN

Secure Network

Een volledig en beveiligd netwerk op kantoor.

Secure Internet

Veilige glasvezel internetlijn met Firewall.

Fiber Internet Connectivity

Zakelijk glasvezel internet.

TOOLS

Network optimisation

Houdt uw netwerk in vorm.

Wi-Fi site survey

Verbeter het WiFi bereik op kantoor.

- Succesverhalen

- Over ons

- Blog

- Contact

- Werken bij

- Webshop

- Support

- Prijzen >